2010年歐盟EMA與歐洲ENCePP網路中心(European Network of Centers for Pharmacoepidemiology and Pharmacovigilance)共同發布「藥物流行病學方法學標準的指南」草案(Draft CUIDE ON Methodological Standards in Pharmacoepidemiology),該指南是為了確保高品質的藥物流行病學研究,以加強藥品上市的安全性監測,以期維護民眾的健康,而今,ENCePP的指南仍是從事藥物流行病學研究及臨床流行病學研究的重要參考依據[1,2],在該指南中提到了幾項重要的研究偏誤,是值得關注的。

利用健保資料庫分析作為藥物的安全性監測已行之多年,但不良的研究設計容易造成各種推論的偏誤(bias),其中一項重要的偏誤往往導致所觀察的藥物被宣稱對疾病有保護作用,或能降低不良反應,這種偏誤與觀察的時間有關,被稱為immortal time bias。

根據加拿大Suissa博士 2007年發表於Pharmacoepidemiology and drug safty[3]的文章所描述,許多文章都因immortal time bias而誇大了藥物的保護作用,若經由校正藥物的time-dependent definition後(後面會再解釋) ,研究結果就不再顯著,甚至結果是相反的。 並且immortal time愈長,造成的 bias就愈大 ,兩者成正比 。而immortal time bias是如何發生的呢?

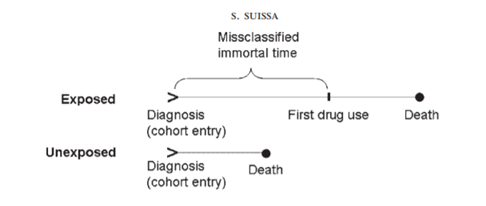

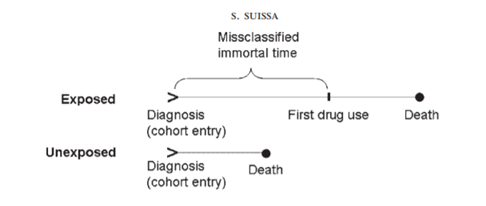

Immortal time係指當病人被診斷為特定疾病至開始用藥的這段時間[2,3], immortal time bias主要發生在Immortal time這段時間,一是將暴露組(用藥組)的person-time做出錯誤的歸類(misclassification),二是將暴露組的Immortal time刪除。筆者試著以下面的兩張插圖(繪圖:S. Suissa PhD)做進一步的解釋: